DeepSeek provou que o treinamento de IA não exige as GPUs mais caras, como a H100. Em vez disso, as empresas podem alcançar alto desempenho com custos mais baixos utilizando GPUs NVIDIA A100, V100 ou H800 recondicionadas.

IA econômica com GPUs NVIDIA A100 e V100

A inteligência artificial está evoluindo rapidamente, e empresas ao redor do mundo estão buscando maneiras de construir infraestrutura de IA sem gastar excessivamente. O sucesso da DeepSeek, uma empresa chinesa de IA, demonstrou que a IA de ponta não precisa das GPUs mais recentes ou caras, mas sim da escolha certa de hardware para a tarefa.

Por exemplo, o ChatGPT foi treinado utilizando GPUs NVIDIA V100 e A100, enquanto a DeepSeek usou cerca de 2.000 GPUs NVIDIA H800, um modelo projetado para a China com largura de banda reduzida entre chips em comparação com sua versão global, a H100.

Embora A100 e V100 sejam modelos de gerações anteriores, eles ainda são altamente eficazes para o treinamento e inferência de IA. Isso destaca uma mudança importante: as empresas podem alcançar um desempenho poderoso em IA com opções mais econômicas, como A100 e V100, sem precisar investir nas GPUs mais recentes e caras.

O que é a DeepSeek?

A DeepSeek é uma empresa chinesa de IA que ganhou reconhecimento global ao desenvolver um modelo de IA que pode rivalizar com o ChatGPT da OpenAI, mas a um custo significativamente menor. Diferente dos gigantes da IA nos Estados Unidos, que investem bilhões em infraestrutura, a DeepSeek afirma ter treinado sua IA utilizando apenas 2.000 GPUs NVIDIA H800, provando que o alto desempenho em IA não exige o hardware mais caro.

Essa abordagem posiciona a DeepSeek como uma alternativa econômica no desenvolvimento de IA, desafiando a ideia de que IA de ponta precisa de investimentos financeiros massivos.

Quem é o dono da DeepSeek?

A DeepSeek foi fundada em julho de 2023 por Liang Wenfeng, um graduado da Universidade de Zhejiang com experiência em estratégias de investimento baseadas em IA. Seu fundo de hedge, High-Flyer, forneceu o financiamento inicial, e ele detém 84% da empresa por meio de duas holdings.

O surgimento da DeepSeek representa uma mudança no desenvolvimento de IA, mostrando que modelos de IA podem ser treinados de maneira eficiente sem a necessidade de infraestrutura bilionária, o que pode reformular a forma como as empresas investem em IA.

Construindo servidores de IA com custo reduzido utilizando GPUs NVIDIA A100 recondicionadas

À medida que a adoção da IA cresce, as empresas estão repensando suas estratégias de hardware. Em vez de gastar milhões nas GPUs mais recentes, muitas estão optando por GPUs NVIDIA A100 recondicionadas para expandir sua infraestrutura de IA com uma fração do custo.

Fora da China, a A100 é a melhor alternativa à H800, oferecendo capacidade semelhante de treinamento de IA com melhor disponibilidade global. Enquanto a V100 continua sendo uma boa opção para inferência, a A100 oferece maior eficiência, escalabilidade e largura de banda de memória para aplicações modernas de IA.

A H100 é a opção mais poderosa, mas a A100 oferece o melhor equilíbrio entre custo e desempenho para empresas que buscam otimizar seus investimentos em IA.

Por que escolher GPUs A100 recondicionadas?

✔ Até 70% de economia – Desempenho de IA para empresas a custos reduzidos

✔ Sustentável e eficiente – Prolonga a vida útil da GPU e reduz despesas com TI

✔ Otimizada para IA – Ideal para deep learning e grandes modelos de linguagem (LLMs)

Menor custo, máximo desempenho

O alto custo do hardware novo limita a adoção da IA, mas as GPUs A100 recondicionadas oferecem grande capacidade de processamento para deep learning, treinamento de modelos e aplicações de IA em tempo real, ajudando as empresas a se manterem competitivas.

Além das economias financeiras, as GPUs recondicionadas liberam capital para pesquisa em IA, otimização de dados e desenvolvimento de software, acelerando a inovação sem comprometer a flexibilidade financeira.

A NVIDIA H100 é, de longe, a GPU mais poderosa para cargas de trabalho de IA, mas tem um custo significativamente mais alto. A A100, por outro lado, oferece a melhor relação custo-benefício, sendo ideal para empresas que precisam de treinamento de IA de alta velocidade sem os altos custos de um upgrade para a H100.

Como a NVIDIA A100 se compara à H800?

A H800 é uma variante da H100 específica para a China, projetada com largura de banda NVLink reduzida e desempenho geral inferior devido às restrições de exportação dos Estados Unidos. Embora a H800 ofereça fortes capacidades de IA, empresas fora da China não podem acessá-la e precisam de uma alternativa.

Para empresas fora da China, a A100 é a melhor alternativa à H800, oferecendo alto desempenho e eficiência para IA. No entanto, a H100 continua sendo a principal escolha para aqueles que precisam do mais alto nível de poder computacional para IA.

| Especificação | NVIDIA H100 | NVIDIA H800 | NVIDIA A100 |

|---|---|---|---|

| Arquitetura | Hopper | Hopper | Ampere |

| Tecnologia de Processo | 4nm TSMC | 4nm TSMC | 7nm TSMC |

| Memória da GPU | 80GB HBM3 | 80GB HBM3 | 40GB/80GB HBM2e |

| Largura de Banda da Memória | Até 3,35 TB/s (SXM) | ~1.9 TB/s (SXM) | Até 2,0 TB/s (versão de 80GB) |

| Largura de Banda NVLink | 900 GB/s | 400 GB/s | 600 GB/s |

| Geração PCIe | PCIe 5.0 | PCIe 4.0 | PCIe 4.0 |

| Desempenho | Melhor desempenho para treinamento e inferência de IA | Desempenho reduzido devido à menor largura de banda NVLink | Forte desempenho para treinamento de IA e HPC |

| Disponibilidade no mercado | Global (IA empresarial, HPC) | Limitado à China | Global |

| Melhor uso | Grandes modelos de IA, treinamento de LLM, IA de alto desempenho | IA econômica para empresas chinesas | Treinamento de IA, deep learning, cargas de trabalho HPC |

Economize até 70% ao comprar uma GPU NVIDIA A100 recondicionada da Renewtech

A GPU NVIDIA A100 Tensor Core foi projetada para treinamento de IA, deep learning e inferência. Ela oferece alto desempenho de largura de banda para cargas de trabalho exigentes de IA, custando uma fração do valor dos modelos mais novos.

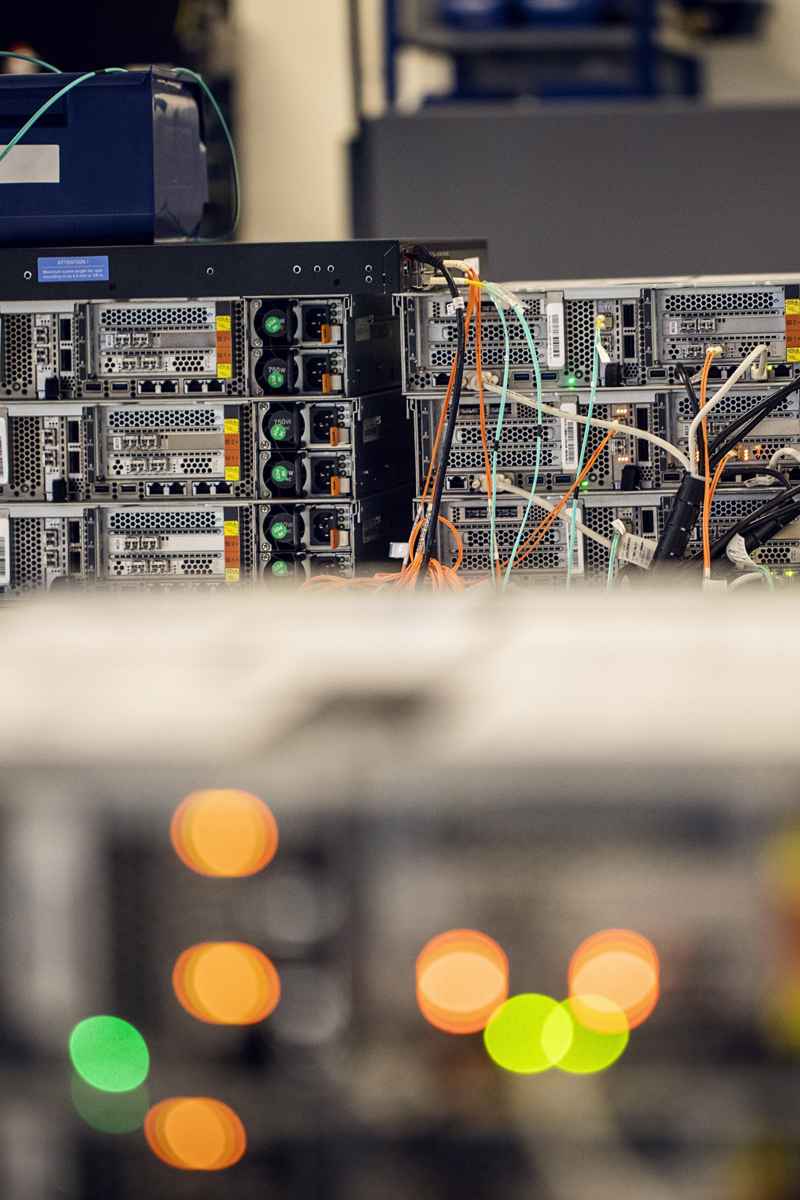

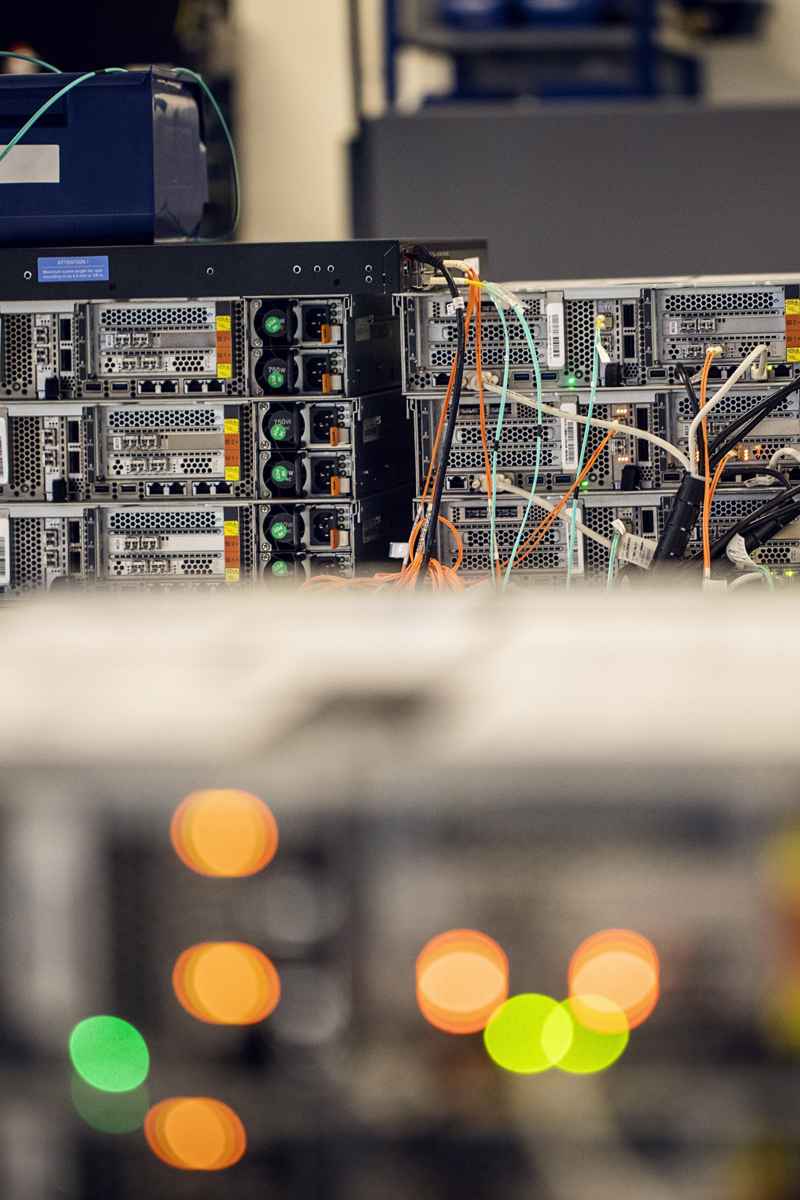

Servidores de IA que suportam a NVIDIA A100

Escolher o servidor de IA certo é essencial para garantir escalabilidade, eficiência e custo-benefício. Cargas de trabalho de IA, como deep learning, grandes modelos de linguagem (LLMs) e inferência em tempo real, exigem hardware potente para maximizar o desempenho sem custos desnecessários.

Para empresas que desejam expandir sua infraestrutura de IA de forma acessível, as GPUs NVIDIA A100 recondicionadas oferecem alto poder de computação por uma fração do custo. Para simplificar a escolha, selecionamos dois servidores de IA de alto desempenho que suportam totalmente as GPUs NVIDIA A100, garantindo o equilíbrio ideal entre velocidade, confiabilidade e eficiência de custos.

Por que escolher o servidor de IA certo é importante

- Cargas de trabalho otimizadas – Treinamento de IA, inferência e deep learning exigem GPUs de alto desempenho, memória e largura de banda PCIe para operação eficiente.

- Escalabilidade e preparação para o futuro – Um servidor bem escolhido garante uma expansão tranquila conforme crescem as demandas de IA.

- Eficiência de custos – Investir no hardware correto maximiza o retorno sobre o investimento e minimiza desperdícios de recursos.

Com servidores de IA equipados com NVIDIA A100, as empresas podem construir uma infraestrutura de IA robusta, garantindo alto desempenho sem ultrapassar o orçamento.

Supermicro SYS-4028GR-TRT vs. Dell PowerEdge R740 para IA

Selecionar o servidor de IA certo é fundamental para maximizar desempenho e eficiência. Tanto o Supermicro SYS-4028GR-TRT quanto o Dell PowerEdge R740 suportam GPUs NVIDIA A100, mas são projetados para diferentes tipos de cargas de trabalho de IA.

-

O Supermicro SYS-4028GR-TRT foi desenvolvido para deep learning em larga escala, suportando até 4 GPUs NVIDIA A100, tornando-se a escolha superior para empresas que precisam de alta densidade de GPUs.

-

O Dell PowerEdge R740, por outro lado, suporta até 2 GPUs A100, sendo uma alternativa mais econômica para empresas focadas em inferência de IA e treinamento em menor escala.

Abaixo está uma comparação lado a lado para ajudá-lo a decidir qual servidor de IA melhor atende às suas necessidades de infraestrutura de GPU.

| Característica | Supermicro SYS-4028GR-TRT | Dell PowerEdge R740 |

| Suporte para GPU | Até 4x NVIDIA A100 PCIe – Otimizado para cargas de trabalho de IA com múltiplas GPUs. | Até 2x NVIDIA A100 PCIe – Projetado para aceleração de IA com eficiência de custo. |

| Opções de CPU | Intel Xeon Scalable (2ª geração) – Suporte para dois sockets para alto desempenho em IA. | Intel Xeon Scalable (2ª geração) – Bem equilibrado para cargas de trabalho de inferência. |

| Capacidade de memória | Até 6TB DDR4 – Construído para grandes modelos de IA e deep learning. | Até 3TB DDR4 – Suporta cargas de trabalho de IA, mas com menor escalabilidade. |

| Capacidades de armazenamento | Suporta até 24x unidades de 2,5” (HDD/SSD) – Projetado para treinamento de IA intensivo em dados. | Suporta até 16x unidades de 2,5” (HDD/SSD) – Suficiente para aplicações de inferência. |

| Rede e conectividade | Múltiplas opções de 10GbE e 25GbE, PCIe 4.0 para alto fluxo de dados de IA. | Duas portas 10GbE, PCIe 4.0, adequado para eficiência em inferência de IA. |

| Expansão e escalabilidade | Mais slots PCIe Gen 4 – Ideal para configurações multi-GPU e expansões futuras. | Forte suporte para PCIe 4.0 – Bom para cargas de trabalho de IA, mas com escalabilidade multi-GPU limitada. |

| Resfriamento e energia | Otimizado para GPUs de alta densidade – Resfriamento avançado para lidar com várias A100s com eficiência. | Gerenciamento térmico eficiente – Resfriamento otimizado para cargas de trabalho de inferência. |

| Formato e densidade | Servidor em rack 4U – Maior densidade, projetado para treinamento de modelos de IA em larga escala. | Servidor em rack 2U – Solução compacta com capacidade moderada de aceleração de IA. |

| Foco de uso | Treinamento de modelos de IA, deep learning e grandes modelos de linguagem – Ideal para pesquisa e produção de IA. | Inferência de IA, implantação econômica de IA – Otimizado para empresas que escalam a IA de forma eficiente em custos. |

Supermicro SYS-4028GR-TRT

Um servidor de IA de alta densidade projetado para computação multi-GPU, o Supermicro SYS-4028GR-TRT foi desenvolvido para maximizar o desempenho da NVIDIA A100. Com amplas conexões PCIe 4.0, eficiência energética robusta e resfriamento avançado, ele garante cargas de trabalho estáveis para treinamento e inferência de IA.

- Otimizado para IA e aprendizado de máquina – suporta configurações multi-GPU, tornando-o ideal para deep learning e grandes modelos de IA.

- Desempenho em nível empresarial – alta largura de banda e eficiência de resfriamento para lidar com cálculos intensivos de IA.

Expanda o desempenho da IA com o Supermicro SYS-4028GR-TRT

Dell PowerEdge R740

Um servidor corporativo versátil, o Dell PowerEdge R740 oferece uma solução escalável para cargas de trabalho de IA e computação de alto desempenho (HPC). Suportando várias GPUs NVIDIA A100, ele fornece alta capacidade de memória, resfriamento eficiente e forte desempenho PCIe 4.0.

- Infraestrutura de IA escalável – configurável para treinamento de modelos de IA, inferência e computação de alto desempenho.

- Desempenho econômico – um R740 recondicionado permite que empresas integrem IA sem gastar excessivamente, mantendo alto desempenho com custos reduzidos.

Expanda o desempenho da IA com o PowerEdge R740

Maximizando o desempenho de IA com servidores H100

Para empresas que precisam de mais poder de computação para aplicações avançadas de IA, a atualização para GPUs NVIDIA H100 oferece um dos mais altos níveis de desempenho de IA disponíveis. Seja para deep learning em larga escala, treinamento de LLMs ou inferência de IA em tempo real, a escolha da infraestrutura certa é fundamental.

Diferente das gerações anteriores de GPUs, as H100 oferecem:

- Aceleração de IA incomparável – operações matriciais mais rápidas, maior largura de banda NVLink e maior eficiência de memória.

- Escalabilidade preparada para o futuro – otimizada para treinamento de IA, HPC e cargas de trabalho empresariais com suporte para PCIe 5.0.

Empresas que lidam com grandes conjuntos de dados de IA, simulações em grande escala ou ajustes avançados de modelos se beneficiarão ao implementar servidores compatíveis com H100. Esses servidores são projetados para lidar com cargas de trabalho exigentes, garantindo tempos de treinamento mais rápidos, inferência em tempo real e escalabilidade contínua para projetos futuros de IA.

Com servidores de IA recondicionados, as empresas podem integrar GPUs H100 a um custo reduzido, evitando despesas desnecessárias com infraestrutura e ainda aproveitando um desempenho de alto nível.

Abaixo, selecionamos dois servidores de IA de alto desempenho que oferecem suporte total às GPUs NVIDIA H100, garantindo que as empresas tenham o poder computacional necessário sem ultrapassar o orçamento.

Dell R750 vs. Lenovo SR650 V2 para AI

Escolher o servidor certo para IA e deep learning é essencial para maximizar o desempenho e a eficiência. Tanto o Dell PowerEdge R750 quanto o Lenovo ThinkSystem SR650 V2 suportam GPUs NVIDIA H100, mas atendem a necessidades ligeiramente diferentes.

O R750 oferece mais slots PCIe para melhor expansão, enquanto o SR650 V2 se concentra na escalabilidade e eficiência de custos. Abaixo está uma comparação lado a lado para ajudar a decidir qual melhor atende à sua infraestrutura de IA.

| Característica | Dell PowerEdge R750 | Lenovo ThinkSystem SR650 V2 |

| Suporte para GPU | Até 2x NVIDIA H100 PCIe | Até 2x NVIDIA H100 PCIe |

| Opções de CPU | Intel Xeon Scalable (3ª geração) | Intel Xeon Scalable (3ª geração) |

| Capacidade de memória | Suporta até 8TB DDR4/DDR5 | Suporta até 8TB DDR4/DDR5 |

| Capacidades de armazenamento | Suporta até 28x unidades de 2,5” (HDD/SSD) | Suporta até 28x unidades de 2,5” (HDD/SSD) |

| Rede e conectividade | Duas portas 10GbE, slots PCIe Gen 5 para garantir compatibilidade futura | Duas portas 10GbE, PCIe Gen 4, alta eficiência energética |

| Expansão e escalabilidade | Mais slots PCIe Gen 4/5 – Ideal para configurações multi-GPU e aceleradores de IA, como NVIDIA NVLink Bridges. | Design energeticamente eficiente com refrigeração Lenovo Neptune™ – Foca na economia de custos mantendo o desempenho de IA. |

| Resfriamento e energia | Otimizado para cargas de trabalho intensivas de IA – Inclui Dell Smart Cooling para GPUs de alto desempenho como a H100. | Gerenciamento eficiente de resfriamento e energia – Utiliza Lenovo XClarity Controller para equilibrar o consumo de energia em aplicações de IA. |

| Formato e densidade | Servidor em rack 2U – Maior densidade para aplicações de IA empresarial | Servidor em rack 2U – Projetado para escalabilidade e expansão modular de IA |

| Foco de uso | IA empresarial e computação de alto desempenho | Infraestrutura de IA escalável e implantação econômica de IA |

Dell PowerEdge R750

Um servidor corporativo de alto desempenho projetado para aceleração de IA, o PowerEdge R750 suporta até duas GPUs NVIDIA H100 PCIe. Com conexões PCIe Gen 4 e rede de alta velocidade, ele fornece o poder necessário para o treinamento de modelos de IA, inferência e aplicações intensivas em dados.

- Otimizado para IA e aprendizado de máquina – suporta configurações de GPU dupla, acelerando cargas de trabalho de IA e inferência em tempo real.

- Desempenho em nível empresarial – oferece alta largura de banda e gerenciamento eficiente de energia, tornando-se uma escolha forte para empresas focadas em IA.

Expanda o desempenho da IA com o PowerEdge R750

Lenovo ThinkSystem SR650 V2

Este servidor de rack versátil foi projetado para empresas que precisam de escalabilidade. Suportando GPUs de comprimento total, altura total e largura dupla, incluindo a NVIDIA H100, ele é otimizado para cargas de trabalho de IA que exigem processamento rápido, deep learning e análise de big data.

- Infraestrutura de IA preparada para o futuro – desenvolvido para implantações escaláveis de IA, garantindo uma expansão eficiente conforme crescem as demandas.

- Desempenho econômico – um SR650 V2 recondicionado permite que empresas integrem infraestrutura de IA a um custo significativamente menor, tornando a IA de alto desempenho mais acessível.

Expanda o desempenho da IA com o SR650 V2

Precisa de ajuda para escolher o servidor de IA certo?

Escolher o servidor de IA ideal não precisa ser complicado. Seja para GPUs NVIDIA A100 ou H100 recondicionadas ou para recomendações especializadas, estamos aqui para ajudar.

Como podemos ajudar:

✔ Orientação personalizada sobre servidores de IA – encontre a melhor opção para o treinamento de modelos de IA ou necessidades de deep learning.

✔ Alertas de estoque e disponibilidade – seja notificado quando GPUs A100 ou H100 recondicionadas estiverem disponíveis ou descubra soluções alternativas.

Economize até 70% na infraestrutura de IA sem comprometer o desempenho

Precisa de treinamento de IA econômico com A100/V100 ou alto desempenho com GPUs H100? Entre em contato agora para obter orientação especializada, preços e disponibilidade!